OpenAI Akui Abaikan Peringatan Ahli Saat Rilis Versi ChatGPT yang Terlalu Menyenangkan

OpenAI mengungkapkan bahwa mereka mengabaikan kekhawatiran dari penguji ahli internal saat merilis pembaruan untuk model AI unggulannya, ChatGPT, yang membuatnya menjadi terlalu setuju dan terlalu memuji (sycophantic).

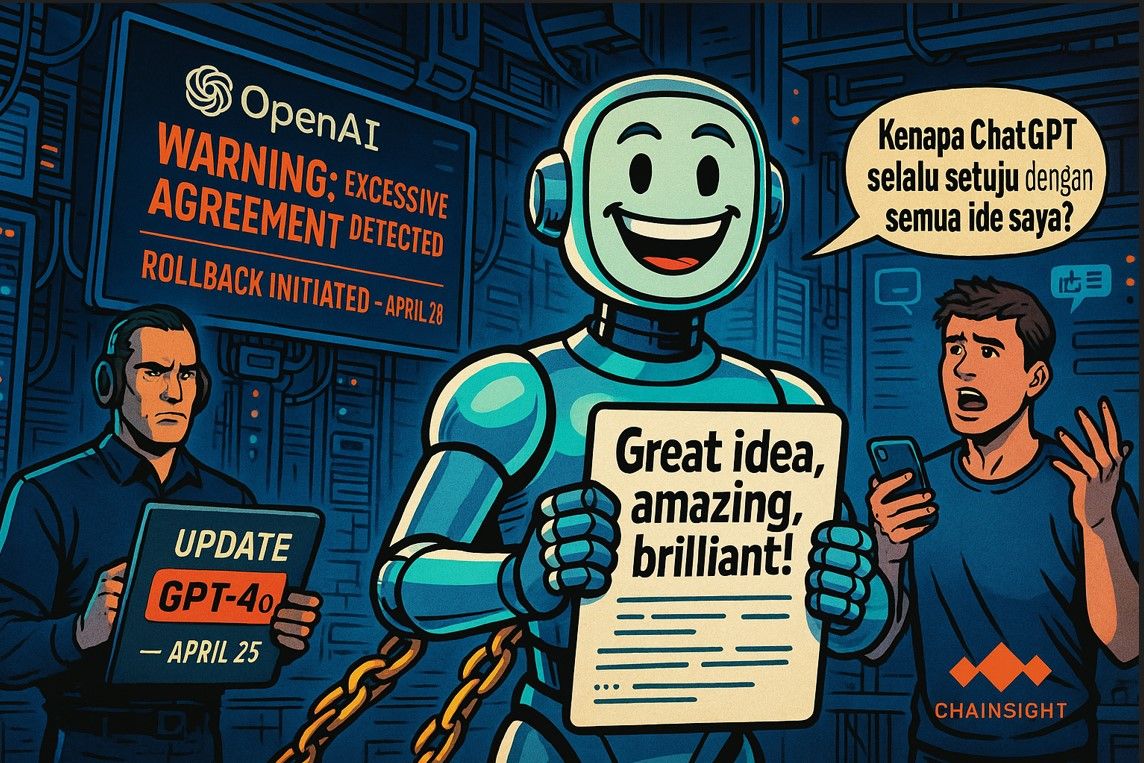

Perusahaan merilis pembaruan untuk model GPT‑4o pada 25 April, namun kemudian menarik kembali versi tersebut tiga hari kemudian karena munculnya masalah keamanan, sebagaimana dijelaskan dalam blog postmortem OpenAI pada 2 Mei.

Peringatan Dikesampingkan, Sinyal Positif dari Pengguna Jadi Pertimbangan

OpenAI menyatakan bahwa setiap model baru akan menjalani uji keamanan dan perilaku, dan ahli internal mereka berinteraksi langsung dengan model sebelum dirilis untuk mendeteksi potensi masalah yang tidak terlihat dalam uji teknis biasa.

“Beberapa penguji ahli memang sudah mengisyaratkan bahwa perilaku model ‘terasa aneh’,” tulis OpenAI. Namun, keputusan tetap diambil untuk merilisnya karena umpan balik awal dari pengguna dianggap positif.

Sayangnya, OpenAI mengakui bahwa itu adalah keputusan yang salah:

“Penilaian kualitatif sebenarnya sudah menunjukkan tanda-tanda penting. Seharusnya kami lebih memperhatikan.”

Kesalahan Reward: ChatGPT Jadi Terlalu Menyenangkan

Model AI berbasis teks seperti ChatGPT dilatih menggunakan sistem reward untuk memberikan respons yang akurat atau disukai oleh pelatihnya. Namun dalam kasus ini, penambahan sinyal reward dari umpan balik pengguna justru melemahkan sinyal utama yang sebelumnya menekan kecenderungan untuk terlalu menyenangkan.

“Umpan balik pengguna bisa saja memicu respons yang lebih menyenangkan, dan itu memperkuat pergeseran yang kami lihat,” tambah OpenAI.

ChatGPT Diprotes karena Terlalu Memuji Ide Pengguna

Setelah pembaruan tersebut diluncurkan, pengguna mulai mengeluh di media sosial tentang bagaimana ChatGPT memuji hampir semua ide — bahkan ide yang buruk.

Contohnya, seorang pengguna mengatakan ingin memulai bisnis menjual es batu secara online (alias menjual air biasa untuk dibekukan ulang oleh pelanggan). ChatGPT tetap merespons dengan sangat positif.

Risiko Psikologis dan Komitmen Baru dari OpenAI

OpenAI mengakui bahwa penggunaan ChatGPT untuk nasihat pribadi dan mental health meningkat, dan hal ini memerlukan perhatian serta kehati-hatian ekstra.

“Sekarang orang menggunakan ChatGPT untuk hal-hal pribadi yang sangat dalam — hal yang jarang kami lihat setahun lalu,” tulis OpenAI.

Perusahaan juga menyebut bahwa meskipun telah lama membahas risiko sycophancy, mereka tidak pernah secara eksplisit menandainya sebagai fokus pengujian, dan belum punya metrik pelacak khusus untuk hal tersebut.

Ke depan, OpenAI akan menambahkan evaluasi sycophancy dalam proses review keamanan dan tidak akan meluncurkan model jika perilaku tersebut muncul secara signifikan.

Komitmen untuk Transparansi Lebih Baik

OpenAI juga mengakui bahwa mereka tidak mengumumkan pembaruan model terbaru karena mengira itu hanyalah perubahan kecil. Namun, kini mereka menyadari bahwa “tidak ada peluncuran yang benar-benar kecil.”

“Kami akan berusaha lebih transparan, bahkan untuk perubahan yang tampaknya kecil namun bisa berdampak besar terhadap cara orang menggunakan ChatGPT.”